Когда мы думаем о роботах, мы часто представляем себе блестящие машины, жужжащие в научно‑фантастических фильмах, или, возможно, думаем о чём‑то, что постепенно становится частью нашей реальности. Но не все роботы механические. В мире SEO боты поисковых систем — это крошечные роботы, исследующие ваш сайт на Drupal, и при правильном руководстве вы можете убедиться, что они придерживаются важных путей. Именно здесь на помощь приходит небольшой текстовый файл под названием «robots.txt».

В этой статье мы изучим robots.txt шаг за шагом. Мы начнём с чёткого определения и объясним, что делает его важной частью хорошего SEO. Затем мы сосредоточимся на том, как именно Drupal обрабатывает robots.txt, какие элементы включает этот файл и как управлять им одновременно технически грамотно и удобно для пользователя.

Что такое robots.txt?

Robots.txt — это небольшой текстовый файл на вашем сайте, который содержит информацию для ботов поисковых систем о том, какие части вашего сайта они могут сканировать, а какие области следует пропустить. Он реализует протокол исключения роботов (Robots Exclusion Protocol) — стандарт, которому следуют большинство поисковых систем.

Важно отметить, что robots.txt не защищает и не скрывает страницы от реальных посетителей. Вместо этого он просто предоставляет инструкции автоматизированным сканерам, таким как Googlebot или Bingbot, направляя их на эффективное исследование вашего сайта.

Почему robots.txt важен

Поисковые системы автоматически сканируют веб‑сайты, чтобы обнаружить и проиндексировать контент. Без чётких указаний они могут тратить время на сканирование страниц, которые приносят мало пользы или не приносят её вовсе, например:

- административные и технические страницы;

- результаты внутреннего поиска и отфильтрованные URL;

- дублирующиеся или автоматически сгенерированные страницы, которые никогда не предназначались для результатов поиска.

Хорошо составленный файл robots.txt помогает гарантировать, что:

- бюджет сканирования (ограничённое внимание, которое поисковые системы уделяют вашему сайту) не тратится на контент низкой ценности;

- важные страницы получают приоритет, которого они заслуживают;

- видимость вашего сайта в результатах поиска остаётся высокой и не размывается;

- ресурсы сервера не перегружаются из‑за ненужного сканирования.

Подводя итог, robots.txt направляет сосредоточенное внимание поисковых систем на наиболее ценный общедоступный контент, безопасно игнорируя остальное.

Управление robots.txt в Drupal

Хорошая новость в том, что Drupal уже берёт на себя большую часть работы, когда дело касается robots.txt. Вот как это работает.

Robots.txt по умолчанию в Drupal

Из коробки Drupal поставляется с уже разумно настроенным файлом robots.txt. Эти настройки обеспечивают прочную основу для большинства сайтов, гарантируя, что поисковые системы эффективно сканируют их.

Когда редактировать robots.txt

В некоторых случаях вам может потребоваться внести изменения по мере развития вашего сайта. Распространённые ситуации, когда обновления полезны, включают:

- новые разделы или страницы: если вы добавляете область сайта, которая должна оставаться приватной (например, промежуточный раздел, внутренние инструменты или страницы только для администраторов);

- удалённый или реорганизованный контент: когда URL удаляются или пути меняются;

- новые каталоги файлов или медиа: если вы добавляете папки для изображений, загрузок или скриптов, которые не нужно индексировать;

- изменения стратегии SEO: например, если вы хотите, чтобы поисковые системы фокусировались только на определённых разделах или если вы реструктурируете категории;

- переход с односайтового на многосайтовый режим: каждому новому сайту может потребоваться свой собственный файл robots.txt, особенно если контент или структура различаются (мы поговорим о конкретных опциях для многосайтовых установок более подробно позже).

Robots.txt vs. другие инструменты SEO

Robots.txt в первую очередь влияет на сканирование, а не на индексацию (по крайней мере, не напрямую):

- сканирование — это когда боты поисковых систем посещают ваш сайт и читают страницы;

- индексация — это когда поисковые системы анализируют страницу, решают, должна ли она появляться в результатах поиска, и сохраняют её в своём индексе.

Robots.txt влияет на индексацию только косвенно. Например, если вы блокируете административные страницы от сканирования, поисковые системы не могут прочитать их содержимое, поэтому эти страницы обычно не индексируются. Но это не гарантировано — заблокированная страница всё равно может появиться как простой URL в результатах поиска, если на неё ссылаются другие страницы.

Вот почему robots.txt лучше всего понимать как набор инструкций для сканеров, а не как инструмент для SEO‑решений на уровне страниц. Для точного контроля над индексацией и тем, как страницы отображаются в результатах поиска, Drupal полагается на другие механизмы SEO, такие как мета‑теги noindex/nofollow, канонические URL, включение или исключение из карты сайта и многое другое. Вместе эти инструменты дополняют robots.txt, обеспечивая эффективное сканирование и точную индексацию.

Анатомия robots.txt (с реальным примером для Drupal)

Robots.txt опирается на директивы (такие как «User‑agent», «Allow» и «Disallow»). Вы можете использовать их для формирования правил того, как боты поисковых систем должны сканировать ваш сайт.

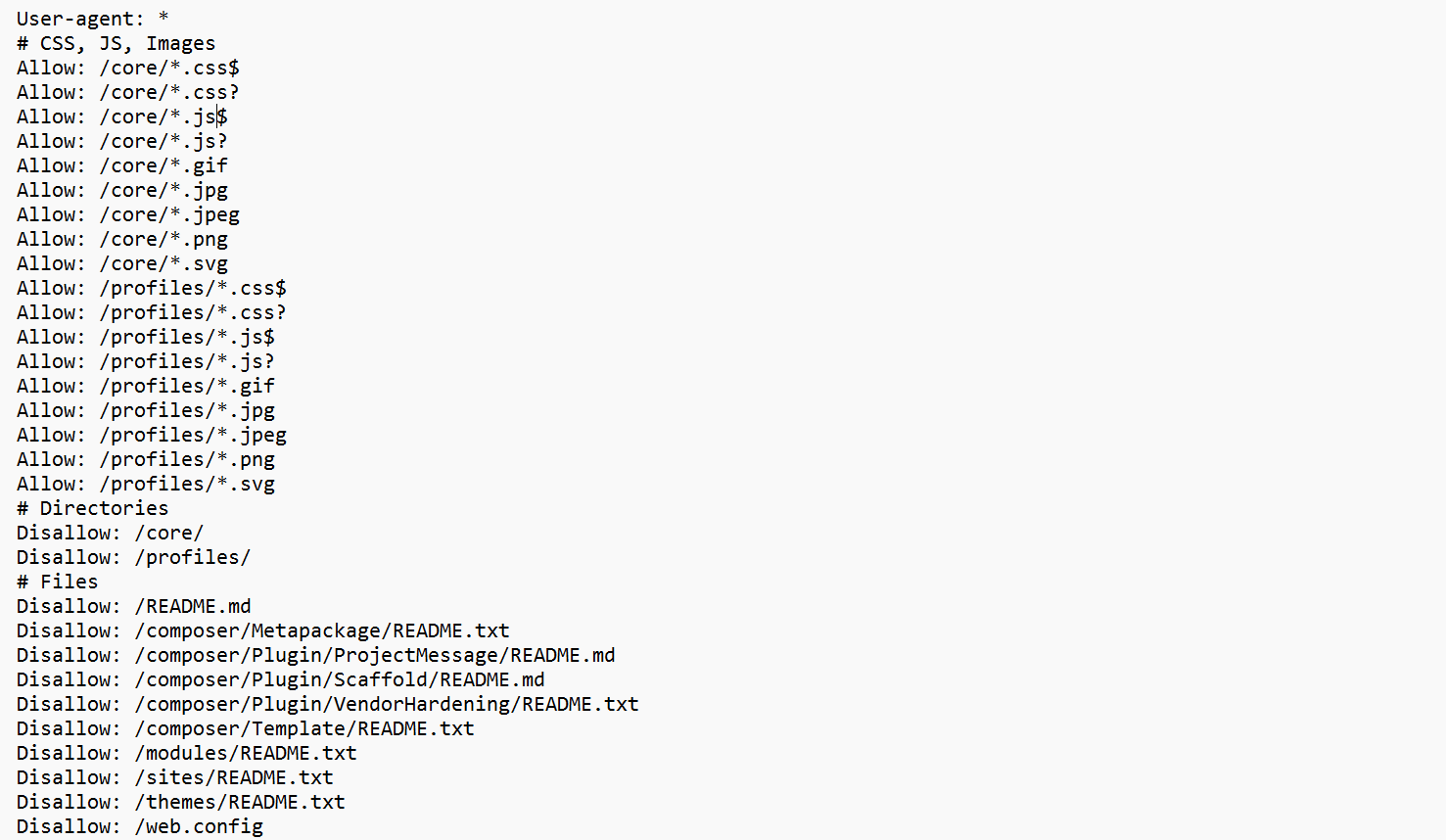

Файл robots.txt по умолчанию в Drupal уже включает разумные правила, поэтому он — отличный способ понять, как все это работает на практике.

Для ясности правила в файле robots.txt по умолчанию в Drupal организованы по типу ресурсов, таких как CSS, JavaScript, изображения, файлы, каталоги и пути URL. Например, вы найдёте раздел с меткой # Directories, объединяющий правила, которые блокируют или разрешают целые папки. Такая структура упрощает чтение файла, делает его безопаснее для корректировки и снижает вероятность возникновения проблем с SEO.

Однако поисковым ботам всё равно на заголовки или порядок. Для них важна специфика правил: когда к одному и тому же URL применяются несколько правил, более длинный (подробный) путь имеет приоритет над более коротким. Мы рассмотрим примеры этого в следующем разделе.

Директива User‑agent: к кому применяются правила

Директива User‑agent в верхней части файла указывает, к каким веб‑сканерам применяются следующие правила. В файле Drupal по умолчанию это выглядит так:

User-agent: *

Это означает, что все следующие правила применяются ко всем ботам поисковых систем, и это самый распространённый вариант.

Директива Disallow: куда ботам нельзя заходить

Директива Disallow предписывает ботам не сканировать определённые ресурсы. Вы заметите множество правил Disallow в файле Drupal по умолчанию, например:

Disallow: /admin/

Disallow: /user/login

Disallow: /search/

Эти правила предписывают ботам не сканировать административные, связанные с пользователями или результаты внутреннего поиска страницы. Такие страницы необходимы для функциональности сайта, но редко полезны в результатах поиска.

Drupal также блокирует технические файлы и каталоги:

Disallow: /core/

Disallow: /profiles/

Disallow: /themes/README.txt

Эти файлы помогают работе сайта, но не имеют SEO‑ценности, поэтому их исключение помогает ботам сосредоточиться на реальном контенте.

Если для бота нет директивы Disallow, этот бот может сканировать всё. Если есть Disallow: /, боту запрещается сканировать все.

Директива Allow: разрешение ботам доступа к важным ресурсам

Напротив, директива Allow, разрешает ботам сканировать определённые ресурсы. Например, хотя системные каталоги вроде /core/ заблокированы, Drupal явно разрешает доступ к ресурсам внутри них:

Allow: /core/*.css$

Allow: /core/*.js$

Allow: /core/*.png

Знак «$» — это специальный символ в шаблонах robots.txt, который соответствует концу URL. Например, «Allow: /core/*.css$» означает разрешение любого URL в /core/, который заканчивается на .css (например, /core/assets/style.css). Как упоминалось ранее, URL сопоставляется со всеми правилами, и наиболее точное совпадение побеждает — самый длинный путь имеет приоритет.

Вот почему это важно. Поисковым системам нужно видеть CSS, JavaScript и изображения, чтобы понять, как выглядят и функционируют ваши страницы. Разрешение им сканировать эти файлы помогает правильно отображать страницу, что может улучшить ранжирование и индексацию в поиске. В то же время блокировка каталогов вроде /core/ не даёт ботам тратить время на системные файлы, которые не являются частью вашего публичного контента и не имеют SEO‑ценности.

Чистые URL и правила совместимости

Drupal включает как чистые URL, так и пути старого стиля, чтобы гарантировать, что административные страницы заблокированы независимо от того, как сформирован URL. Хотя современные сайты на Drupal обычно используют чистые URL (например, /admin/), некоторые серверы или устаревшие настройки могут по‑прежнему предоставлять пути, включающие index.php, поэтому для полноты учтены оба варианта.

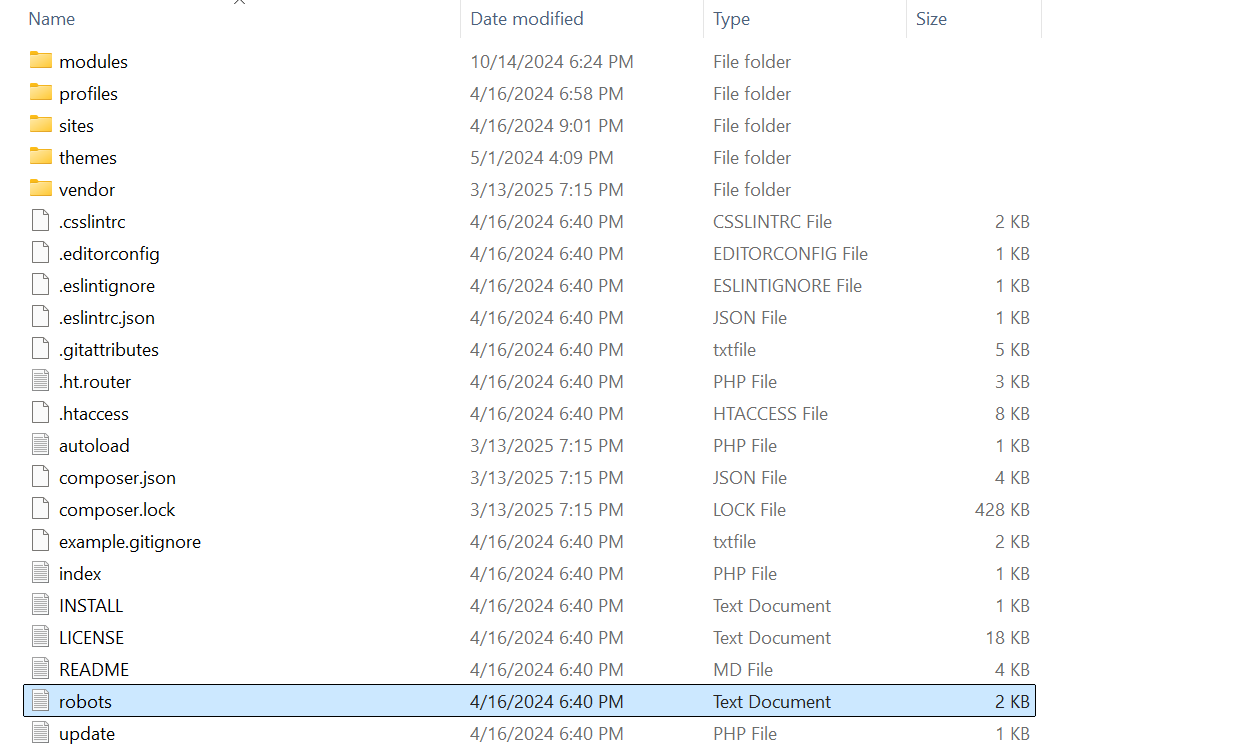

Как управлять robots.txt через файловую систему Drupal

В стандартной установке Drupal robots.txt — это статический файл, расположенный в корне проекта рядом с такими файлами, как index.php. Корень вашего сайта — это основная папка верхнего уровня, где находится сайт и где расположены ключевые файлы.

Это означает, что robots.txt обслуживается напрямую веб‑сервером. Поисковые системы могут получить к нему доступ по адресу https://example.com/robots.txt без предварительной загрузки Drupal. Такая настройка преднамеренна. Поисковые системы ожидают, что robots.txt будет быстрым, простым и всегда доступным, даже если сам сайт испытывает проблемы.

Управление robots.txt в Drupal обычно означает прямое редактирование файла:

- Откройте файл robots.txt в своём редакторе кода.

- Откорректируйте или добавьте правила по мере необходимости.

- Сохраните файл, затем разверните его на сервере, чтобы обновлённая версия стала частью вашего действующего сайта. (На практике это означает публикацию файла так же, как и при любом другом изменении кода, например, фиксацию через Git или загрузку через рабочий процесс развёртывания.)

- Проверьте результат в браузере. Посетите https://example.com/robots.txt, чтобы убедиться, что новые правила видны и корректны.

Поскольку это простой текстовый файл, обновления легко проверить и отменить при необходимости. Лучшая практика — отслеживать изменения с помощью Git, широко используемой системы контроля версий для разработки программного обеспечения. Таким образом, каждое редактирование документируется, и вы можете восстановить более ранние версии при необходимости.

В файле нет скрытой логики или слоя конфигурации: то, что вы видите в файле, — это именно то, что читают поисковые системы.

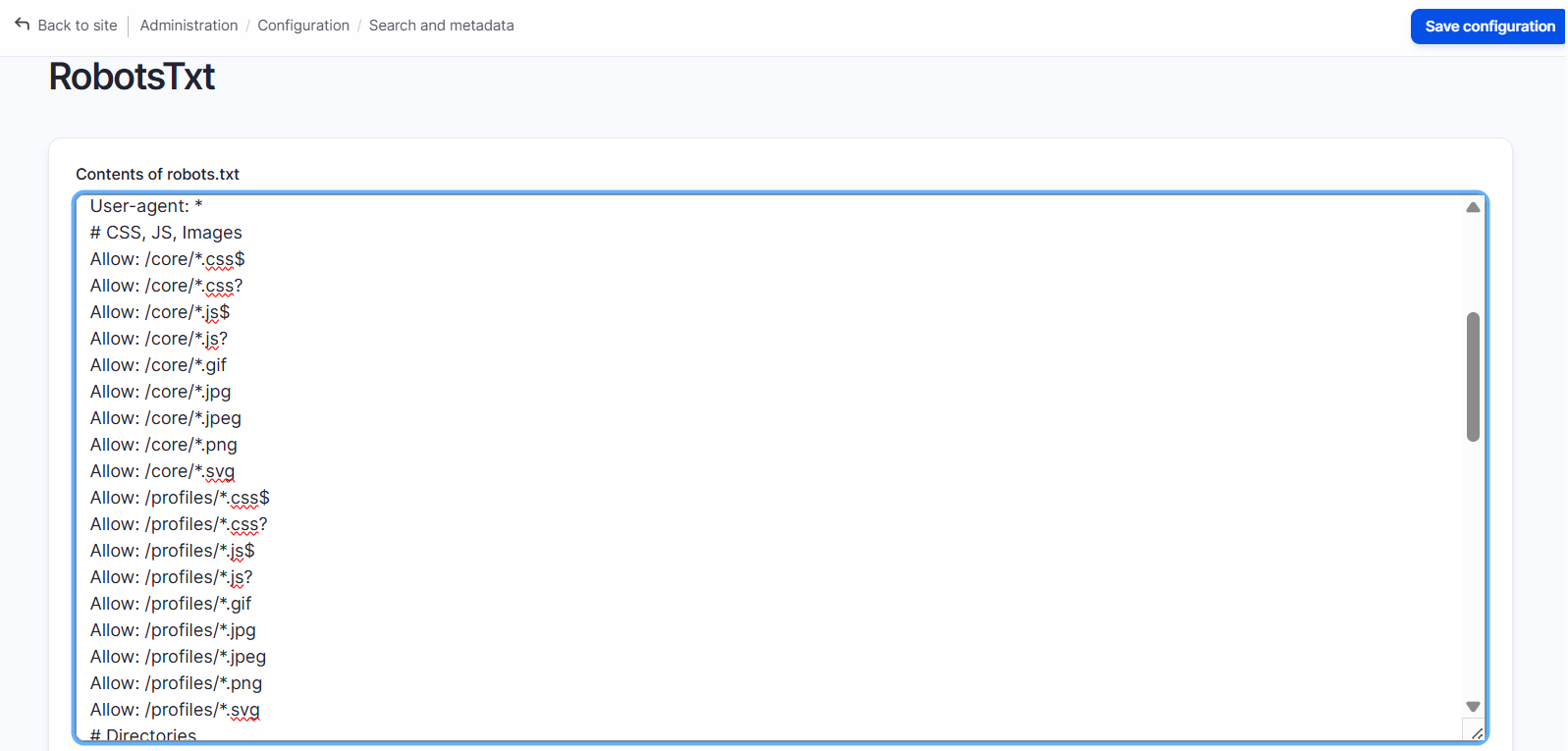

Как управлять robots.txt через модуль Drupal

Модули могут упростить управление, особенно для редакторов, которые предпочитают веб‑интерфейс, или когда речь идёт о более сложных настройках. Модуль Robots.txt — наиболее широко используемый модуль, предлагающий такой подход.

Значимость этого модуля подтверждается тем фактом, что он включён в SEO Tools Recipe — подобранный пакет SEO в Drupal CMS, специальную версию Drupal, адаптированную для пользователей без технических навыков.

Этот модуль особенно полезен в многосайтовых настройках, где несколько сайтов на Drupal используют одну и ту же кодовую базу. Каждый сайт может иметь свой собственный robots.txt, генерируемый динамически и редактируемый напрямую из административного интерфейса Drupal.

Лучшие практики для robots.txt на сайтах Drupal

- Делайте все просто. Блокируйте только пути, которые явно не должны появляться в результатах поиска, такие как административные страницы, внутренний поиск или технические каталоги.

- Избегайте излишнего усложнения правил. Слишком много директив может запутать ботов. Простота снижает количество ошибок и позволяет ботам сосредоточиться на ваших важных страницах.

- Используйте надёжные источники для правил. Файл Drupal по умолчанию уже безопасен и эффективен. Также существует официальная документация поисковых систем, где публикуются чёткие рекомендации по синтаксису robots.txt и лучшим практикам. SEO‑модули или генераторы могут предоставить примеры правил и упростить настройку.

- Не блокируйте весь сайт.

- Не полагайтесь на robots.txt для обеспечения безопасности: он только направляет ботов, но не защищает конфиденциальный контент.

Заключительные мысли

Robots.txt — ваш дружелюбный помощник в работе с поисковыми системами: он не делает всего, но гарантирует, что они тратят время на вашем сайте с умом. При продуманном использовании он делает ваш сайт более обнаруживаемым, организованным и дружественным для поиска. Влияние robots.txt значительно, особенно в сочетании с другими практиками SEO в Drupal.